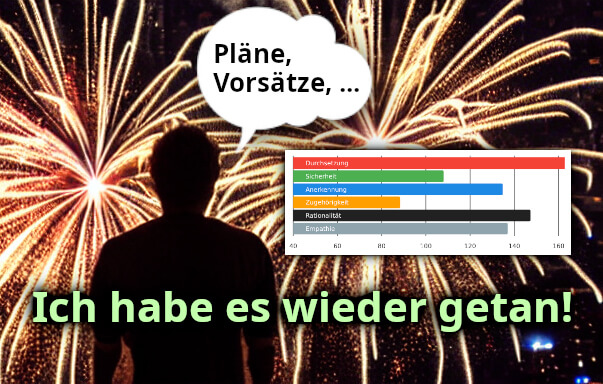

Am 14.6.23 fand in München die corporate content conference in der ASTOR Filmlounge im ARRI statt. In einem gemeinsamen Vortrag mit Christoph Hofmański zeigte Dr. Matthias Boldt praktische Beispiele für eine KI-basierte Motivationsanalysen und die entsprechende Content-Anpassung.

Cloud-Software

Am 14.6.23 findet in München die corporate content conference in der ASTOR Filmlounge im ARRI statt. In einem gemeinsamen Vortrag mit Christoph Hofmański vom IPM Institut für persönlichkeitsorientiertes Management werden wir versuchen, die Möglichkeiten aufzuzeigen, die KI-basierte Motivationsanalysen für die Content-Generierung bieten.

An der Technischen Hochschule Wildau fand vom 27.2. bis 3.3.2023 die 12. Wildauer Wissenschaftswoche statt. Ein Event mit mehreren Veranstaltungsreihen, das unterschiedlichen Interessengruppen die an der Hochschule durchgeführten Arbeiten verständlich machen sollte. Die Veranstaltungen des 2.3. waren vollständig dem Thema Natural Language Processing gewidmet. In diesem Rahmen und unter dem Motto Language Models in der Anwendung – Beispiele aus der Unternehmenspraxis präsentierten Philipp Müller und Matthias Boldt von der sense.AI.tion GmbH ihre Erfahrungen beim Einsatz von KI-Modellen im Natural Language Processing (NLP).

ChatGPT und Persönlichkeit funktioniert nicht? Doch, mit Hilfe einer weiteren KI hilft mir ChatGPT gezielt persönliche Eigenschaften zu simulieren – ein Experiment gefällig?

Es gibt viele Anwendungsfälle für Sprachanalysen, in denen der Kontext eine wesentliche Rolle spielt. Sind Menschen direkt betroffen, dann ist eine exakte Unterscheidung umso wichtiger … Gastbeitrag von Philipp Müller

Die Dokumentation in der Pflege nimmt zu viel Zeit. Durch automatische, sprachgesteuerte KI-Systeme werden Pflegekräfte von Dokumentationsdruck und Bürokratie entlastet.

Es gibt viele Anwendungsfälle für Sprachanalysen, in denen der Kontext eine wesentliche Rolle spielt. Sind Menschen direkt betroffen, dann ist eine exakte Unterscheidung umso wichtiger … Gastbeitrag von Philipp Müller

Die Anzahl an praktisch benötigten KI-Modellen kann schnell Überhand nehmen und die zur Verfügung stehenden IT-Ressourcen strangulieren. Gibt es einen Ausweg aus dieser Falle?

Künstliche Intelligenz in Microservice-Systemen, in Kubernets-Clustern, … funktioniert das überhaupt? Sind das nicht große, unhandliche Module in unpassender Software-Architektur?